首部介紹語音識別中深度學習技術細節的專著。全書首先概要介紹了傳統語音識別理論和經典的深度神經網絡核心算法。

接着全面而深入地介紹了深度學習在語音識別中的應用,包括「深度神經網絡-隱馬爾可夫混合模型」的訓練和優化,特征表示學習、模型融合、自適應,以及以循環神經網絡為代表的若干先進深度學習技術。

俞棟,1998 年加入微軟公司,現任微軟研究院首席研究員、浙江大學兼職教授和中科大客座教授。他是語音識別和深度學習方向的資深專家,出版了兩本專著,發表了150 多篇論文,是近60 項專利的發明人及有廣泛影響力的深度學習開源軟件CNTK 的發起人和主要作者之一。他在基於深度學習的語音識別技術上的工作帶來了語音識別研究方向的轉變,極大地推動了語音識別領域的發展,並獲得2013 年IEEE

信號處理協會佳論文獎。俞棟博士現擔任IEEE 語音語言處理專業委員會委員,曾擔任IEEE/ACM音頻、語音及語言處理匯刊、IEEE 信號處理雜志等期刊的編委。

鄧力,世界著名人工智能、機器學習和語音語言信號處理專家,現任微軟首席人工智能科學家和深度學習技術中心研究經理。他在美國威斯康星大學先后獲碩士和博士學位,然后在加拿大滑鐵盧大學任教獲得終身正教授。其間,他還任麻省理工學院研究職位。1999 年加入微軟研究院歷任數職,並在2014 年初創辦深度學習技術中心,主持微軟公司和研究院的人工智能和深度學習領域的技術創新。

鄧立博士的研究方向包括自動語音與說話者識別、口語識別與理解、語音–語音翻譯、機器翻譯、語言模式、統計方法與機器學習、聽覺和其他生物信息處理、深層結構學習、類腦機器智能、圖像語言多模態深度學習,商業大數據深度分析等。他在上述領域做出了重大貢獻,是ASA(美國聲學學會)會士、IEEE(美國電氣和電子工程師協會)會士和理事、ISCA(國際語音通信協會)會士,並憑借在深度學習與自動語音識別方向做出的傑出貢獻榮獲2015年度IEEE

信號處理技術成就獎。同時,他也曾在高端雜志和會議上發表過與上述領域相關的300 余篇學術論文,出版過5 部著作,發明及合作發明了超過70 多項專利。鄧立博士還擔任過IEEE 信號處理雜志和《音頻、語音與語言處理學報》(IEEE/ACMTransactions on Audio, Speech & anguage Processing)的主編。

俞凱,IEEE

高級會員,上海交通大學計算機科學與工程系特別研究員。清華大學本科、碩士,英國劍橋大學工程系博士。長期從事智能語音及語言處理、人機交互、模式識別及機器學習的研究和產業化工作。他是中組部「千人計划」(青年項目)獲得者,國家自然科學基金委優秀青年科學基金獲得者,上海市「東方學者」特聘教授;作為共同創始人和首席科學家創立「蘇州思必馳信息科技有限公司」。現任中國聲學學會語音語言、聽覺及音樂分會執委會委員,中國計算機學會人機交互專委會委員,中國語音產業聯盟技術工作組副組長。他的研究興趣涉及語音識別、語音合成、口語理解、對話系統、認知型人機交互等智能語音語言處理技術的多個核心技術領域,在本領域的一流國際期刊和會議上發表論文80

余篇,申請專利10 余項,取得了一系列研究、工程和產業化成果。在InterSpeech 及IEEE Spoken Language Processing 等國際會議上獲得3 篇國際會議優秀論文獎,獲得國際語音通信聯盟(ISCA)2013 年頒發的2008—2012 Computer Speech and Language 優論文獎。受邀擔任InterSpeech 2009

語音識別領域主席、EUSIPCO 2011/EUSIPCO 2014 語音處理領域主席、InterSpeech 2014 口語對話系統領域主席等。他負責搭建或參與搭建的大規模連續語音識別系統,曾獲得美國國家標准局(NIST)和美國國防部內部評測冠軍;作為核心技術人員,負責設計並實現的認知型統計對話系統原型,在CMU 組織的2010

年對話系統國際挑戰賽上獲得了可控測試的冠軍。作為項目負責人或Co-PI,他主持了歐盟第7 框架PARLANCE、國家自然科學基金委、上海市教委、經信委,以及美國通用公司、蘇州思必馳信息科技有限公司的一系列科研及產業化項目。2014 年,因在智能語音技術產業化方面的貢獻,獲得中國人工智能學會頒發的「吳文俊人工智能科學技術獎」。

錢彥旻,上海交通大學計算機科學與工程系助理研究員,博士。分別在2007 年6 月和2013 年1 月於華中科技大學和清華大學獲得工學學士和工學博士學位。2013 年4 月起,任上海交通大學計算機科與工程系理研究員。同時從2015 年1 月至2015 年12 月,在英國劍橋大學工程系機器智能實驗室語音組進行訪問,作為項目研究員與語音識別領域的著名科學家Phil Woodland

教授和Mark Gales 教授開展合作研究。現為IEEE、ISCA 會員,同時也是國際開源項目Kaldi 語音識別工具包開發的項目組創始成員之一。此外,擔任IEEE Transactions on Audio, Speech, and Language Processing、SpeechCommunication、ICASSP、Interspeech、ASRU

等國際期刊和會議的審稿人。目前在國內外學術刊物和會議上發表學術論文50 余篇,Google Scholar 總引用數近1000 次。其中包括在語音識別領域優秀國際會議ICASSP、InterSpeech 和ASRU 上發表論文30 余篇,申請國家專利共3 項,已授權1 項。2008 年獲科技奧運先進集體獎,2014

年獲中國人工智能學會頒發的「吳文俊人工智能科學技術獎進步獎」。曾作為負責人和主要參與者參加了包括英國EPSRC、國家自然科學基金、國家863 等多個項目。目前的研究領域包括:語音識別、說話人和語種識別、自然語言理解、深度學習建模、多媒體信號處理等。

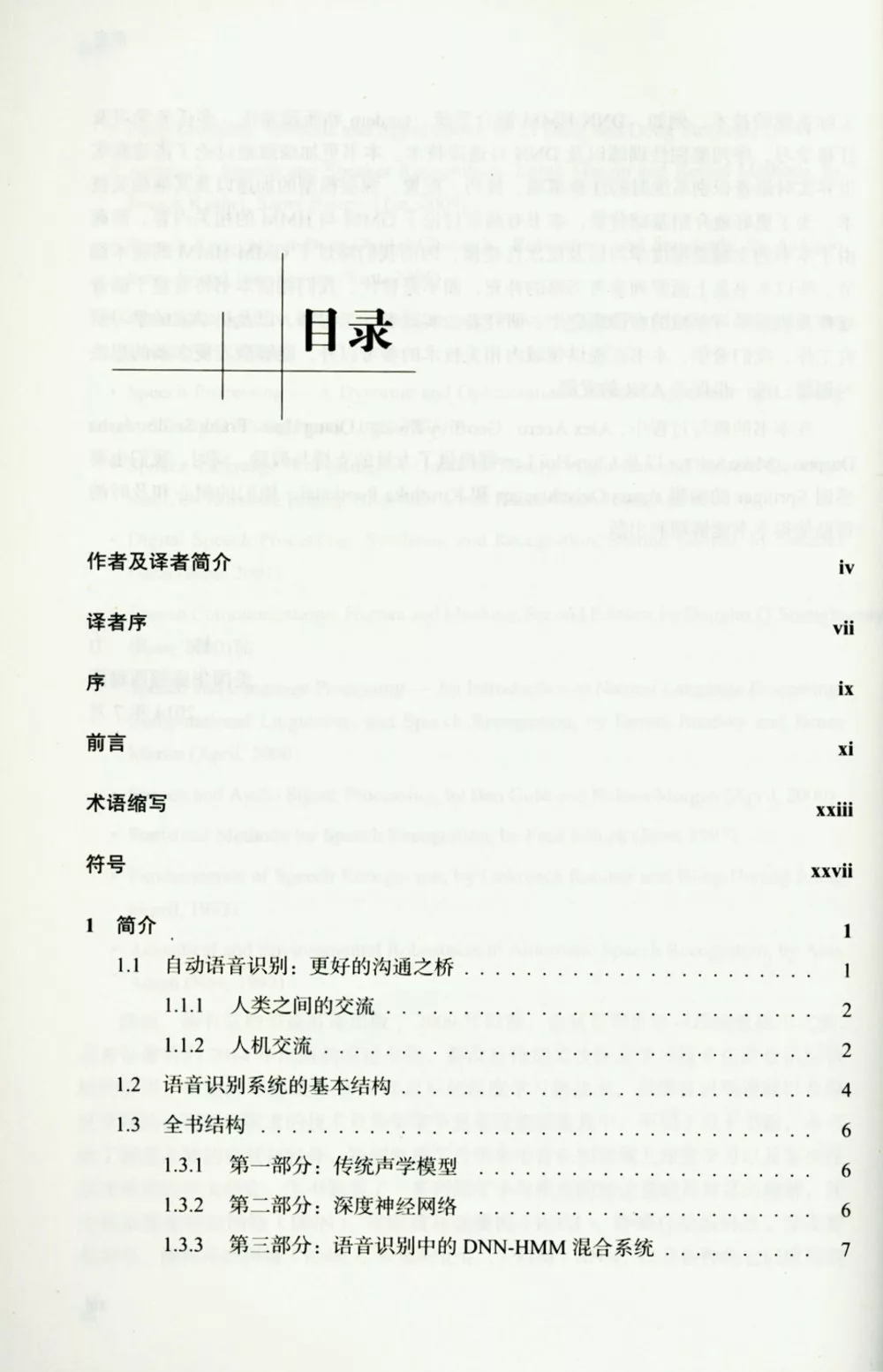

目錄

作者及譯者簡介

譯者序

序

前言

術語縮寫

符號

1簡介

1.1自動語音識別:更好的溝通之橋

1.1.1人類之間的交流

1.1.2人機交流

1.2語音識別系統的基本結構

1.3全書結構

1.3.1第一部分 :傳統聲學模型

1.3.2第二部分 :深度神經網絡

1.3.3第三部分 :語音識別中的DNN—HMM混合系統

1.3.4第四部分 :深度神經網絡中的特征表示學習

1.3.5第五部分 :高級的深度模型

第一部分 傳統聲學模型

2混合高斯模型

2.1隨機變量

2.2高斯分布和混合高斯隨機變量

2.3參數估計

2.4采用混合高斯分布對語音特征建模

3隱馬爾可夫模型及其變體

3.1介紹

3.2馬爾可夫鏈

3.3序列與模型

3.3.1隱馬爾可夫模型的性質

3.3.2隱馬爾可夫模型的仿真

3.3.3隱馬爾可夫模型似然度的計算

3.3.4計算似然度的高效算法

3.3.5前向與后向遞歸式的證明

3.4期望最大化算法及其在學習HMM參數中的應用

3.4.1期望最大化算法介紹

3.4.2使用EM算法來學習HMM參數—Baum—Welch算法

3.5用於解碼HMM狀態序列的維特比算法

3.5.1動態規划和維特比算法

3.5.2用於解碼HMM狀態的動態規划算法

3.6隱馬爾可夫模型和生成語音識別模型的變體

3.6.1用於語音識別的GMM—HMM模型

3.6.2基於軌跡和隱藏動態模型的語音建模和識別

3.6.3使用生成模型HMM及其變體解決語音識別問題

第二部分 深度神經網絡

4深度神經網絡

4.1深度神經網絡框架

4.2使用誤差反向傳播來進行參數訓練

4.2.1訓練准則

4.2.2訓練算法

4.3實際應用

4.3.1數據預處理

4.3.2模型初始化

4.3.3權重衰減

4.3.4丟棄法

4.3.5批量塊大小的選擇

4.3.6取樣隨機化

4.3.7慣性系數

4.3.8學習率和停止准則

4.3.9網絡結構

4.3.10可復現性與可重啟性

5高級模型初始化技術

5.1受限玻爾茲曼機

5.1.1受限玻爾茲曼機的屬性

5.1.2受限玻爾茲曼機參數學習

5.2深度置信網絡預訓練

5.3降噪自動編碼器預訓練

5.4鑒別性預訓練

5.5混合預訓練

5.6采用丟棄手法的預訓練

第三部分 語音識別中的深度神經網絡一隱馬爾可夫混合模型

6深度神經網絡—隱馬爾可夫模型混合系統

6.1DNN—HMM混合系統

6.1.1結構

6.1.2用CD—DNN—HMM解碼

6.1.3CD—DNN—HMM訓練過程

6.1.4上下文窗口的影響

6.2CD—DNN—HMM的關鍵模塊及分析

6.2.1進行比較和分析的數據集和實驗

6.2.2對單音素或者三音素的狀態進行建模

6.2.3越深越好

6.2.4利用相鄰的語音幀

6.2.5預訓練

6.2.6訓練數據的標注質量的影響

6.2.7調整轉移概率

6.3基於KL距離的隱馬爾可夫模型

7訓練和解碼的加速

7.1訓練加速

7.1.1使用多GPU流水線反向傳播

7.1.2異步隨機梯度下降

7.1.3增廣拉格朗日算法及乘子方向交替算法

7.1.4減小模型規模

7.1.5其他方法

7.2加速解碼

7.2.1並行計算

7.2.2稀疏網絡

7.2.3低秩近似

7.2.4用大尺寸DNN訓練小尺寸DNN

7.2.5多幀DNN

8深度神經網絡序列鑒別性訓練

8.1序列鑒別性訓練准則

8.1.1最大相互信息

8.1.2增強型MMI

8.1.3最小音素錯誤/狀態級最小貝葉斯風險

8.1.4統一的公式

8.2具體實現中的考量

8.2.1詞圖產生

8.2.2詞圖補償

8.2.3幀平滑

8.2.4學習率調整

8.2.5訓練准則選擇

8.2.6其他考量

8.3噪聲對比估計

8.3.1將概率密度估計問題轉換為二分類設計問題

8.3.2拓展到未歸一化的模型

8.3.3在深度學習網絡訓練中應用噪聲對比估計算法

第四部分 深度神經網絡中的特征表示學習

9深度神經網絡中的特征表示學習

9.1特征和分類器的聯合學習

9.2特征層級

9.3使用隨意輸入特征的靈活性

9.4特征的魯棒性

9.4.1對說話人變化的魯棒性

9.4.2對環境變化的魯棒性

9.5對環境的魯棒性

9.5.1對噪聲的魯棒性

9.5.2對語速變化的魯棒性

9.6缺乏嚴重信號失真情況下的推廣能力

10深度神經網絡和混合高斯模型的融合

10.1在GMM—HMM系統中使用由DNN衍生的特征

10.1.1使用Tandem和瓶頸特征的GMM—HMM模型

10.1.2DNN—HMM混合系統與采用深度特征的GMM—HMM系統的比較

10.2識別結果融合技術

10.2.1識別錯誤票選降低技術(ROVER)

10.2.2分段條件隨機場(SCARF)

10.2.3最小貝葉斯風險詞圖融合

10.3幀級別的聲學分數融合

10.4多流語音識別

11深度神經網絡的自適應技術

11.1深度神經網絡中的自適應問題

11.2線性變換

11.2.1線性輸入網絡

11.2.2線性輸出網絡

11.3線性隱層網絡

11.4保守訓練

11.4.1L2正則項

11.4.2KL距離正則項

11.4.3減少每個說話人的模型開銷

11.5子空間方法

11.5.1通過主成分分析構建子空間

11.5.2噪聲感知、說話人感知及設備感知訓練

11.5.3張量

11.6DNN說話人自適應的效果

11.6.1基於KL距離的正則化方法

11.6.2說話人感知訓練

……

第五部分 先進的深度學習模型

參考文獻

譯者序

序

前言

術語縮寫

符號

1簡介

1.1自動語音識別:更好的溝通之橋

1.1.1人類之間的交流

1.1.2人機交流

1.2語音識別系統的基本結構

1.3全書結構

1.3.1第一部分 :傳統聲學模型

1.3.2第二部分 :深度神經網絡

1.3.3第三部分 :語音識別中的DNN—HMM混合系統

1.3.4第四部分 :深度神經網絡中的特征表示學習

1.3.5第五部分 :高級的深度模型

第一部分 傳統聲學模型

2混合高斯模型

2.1隨機變量

2.2高斯分布和混合高斯隨機變量

2.3參數估計

2.4采用混合高斯分布對語音特征建模

3隱馬爾可夫模型及其變體

3.1介紹

3.2馬爾可夫鏈

3.3序列與模型

3.3.1隱馬爾可夫模型的性質

3.3.2隱馬爾可夫模型的仿真

3.3.3隱馬爾可夫模型似然度的計算

3.3.4計算似然度的高效算法

3.3.5前向與后向遞歸式的證明

3.4期望最大化算法及其在學習HMM參數中的應用

3.4.1期望最大化算法介紹

3.4.2使用EM算法來學習HMM參數—Baum—Welch算法

3.5用於解碼HMM狀態序列的維特比算法

3.5.1動態規划和維特比算法

3.5.2用於解碼HMM狀態的動態規划算法

3.6隱馬爾可夫模型和生成語音識別模型的變體

3.6.1用於語音識別的GMM—HMM模型

3.6.2基於軌跡和隱藏動態模型的語音建模和識別

3.6.3使用生成模型HMM及其變體解決語音識別問題

第二部分 深度神經網絡

4深度神經網絡

4.1深度神經網絡框架

4.2使用誤差反向傳播來進行參數訓練

4.2.1訓練准則

4.2.2訓練算法

4.3實際應用

4.3.1數據預處理

4.3.2模型初始化

4.3.3權重衰減

4.3.4丟棄法

4.3.5批量塊大小的選擇

4.3.6取樣隨機化

4.3.7慣性系數

4.3.8學習率和停止准則

4.3.9網絡結構

4.3.10可復現性與可重啟性

5高級模型初始化技術

5.1受限玻爾茲曼機

5.1.1受限玻爾茲曼機的屬性

5.1.2受限玻爾茲曼機參數學習

5.2深度置信網絡預訓練

5.3降噪自動編碼器預訓練

5.4鑒別性預訓練

5.5混合預訓練

5.6采用丟棄手法的預訓練

第三部分 語音識別中的深度神經網絡一隱馬爾可夫混合模型

6深度神經網絡—隱馬爾可夫模型混合系統

6.1DNN—HMM混合系統

6.1.1結構

6.1.2用CD—DNN—HMM解碼

6.1.3CD—DNN—HMM訓練過程

6.1.4上下文窗口的影響

6.2CD—DNN—HMM的關鍵模塊及分析

6.2.1進行比較和分析的數據集和實驗

6.2.2對單音素或者三音素的狀態進行建模

6.2.3越深越好

6.2.4利用相鄰的語音幀

6.2.5預訓練

6.2.6訓練數據的標注質量的影響

6.2.7調整轉移概率

6.3基於KL距離的隱馬爾可夫模型

7訓練和解碼的加速

7.1訓練加速

7.1.1使用多GPU流水線反向傳播

7.1.2異步隨機梯度下降

7.1.3增廣拉格朗日算法及乘子方向交替算法

7.1.4減小模型規模

7.1.5其他方法

7.2加速解碼

7.2.1並行計算

7.2.2稀疏網絡

7.2.3低秩近似

7.2.4用大尺寸DNN訓練小尺寸DNN

7.2.5多幀DNN

8深度神經網絡序列鑒別性訓練

8.1序列鑒別性訓練准則

8.1.1最大相互信息

8.1.2增強型MMI

8.1.3最小音素錯誤/狀態級最小貝葉斯風險

8.1.4統一的公式

8.2具體實現中的考量

8.2.1詞圖產生

8.2.2詞圖補償

8.2.3幀平滑

8.2.4學習率調整

8.2.5訓練准則選擇

8.2.6其他考量

8.3噪聲對比估計

8.3.1將概率密度估計問題轉換為二分類設計問題

8.3.2拓展到未歸一化的模型

8.3.3在深度學習網絡訓練中應用噪聲對比估計算法

第四部分 深度神經網絡中的特征表示學習

9深度神經網絡中的特征表示學習

9.1特征和分類器的聯合學習

9.2特征層級

9.3使用隨意輸入特征的靈活性

9.4特征的魯棒性

9.4.1對說話人變化的魯棒性

9.4.2對環境變化的魯棒性

9.5對環境的魯棒性

9.5.1對噪聲的魯棒性

9.5.2對語速變化的魯棒性

9.6缺乏嚴重信號失真情況下的推廣能力

10深度神經網絡和混合高斯模型的融合

10.1在GMM—HMM系統中使用由DNN衍生的特征

10.1.1使用Tandem和瓶頸特征的GMM—HMM模型

10.1.2DNN—HMM混合系統與采用深度特征的GMM—HMM系統的比較

10.2識別結果融合技術

10.2.1識別錯誤票選降低技術(ROVER)

10.2.2分段條件隨機場(SCARF)

10.2.3最小貝葉斯風險詞圖融合

10.3幀級別的聲學分數融合

10.4多流語音識別

11深度神經網絡的自適應技術

11.1深度神經網絡中的自適應問題

11.2線性變換

11.2.1線性輸入網絡

11.2.2線性輸出網絡

11.3線性隱層網絡

11.4保守訓練

11.4.1L2正則項

11.4.2KL距離正則項

11.4.3減少每個說話人的模型開銷

11.5子空間方法

11.5.1通過主成分分析構建子空間

11.5.2噪聲感知、說話人感知及設備感知訓練

11.5.3張量

11.6DNN說話人自適應的效果

11.6.1基於KL距離的正則化方法

11.6.2說話人感知訓練

……

第五部分 先進的深度學習模型

參考文獻

網路書店

類別

折扣

價格

-

新書$474